AI帮大忙,AI犯大错,学术案件中存在误判千万别“算了”!

2026/04/22/周三 11:08

点击量:155

4月,Gallup与Lumina Foundation发布一项覆盖3800名在读大学生的调查显示,47%的人因为AI对就业的影响,至少"相当程度地"考虑过换专业,16%已经换了。

AI自面世以来,以飞速的发展影响社会的日常生活,甚至职业选择,大部分的人都在感叹AI为自己的日常生活乃至社会生产,提供了极大的进步,与此同时,AI也并不是完美产物,它的缺陷,仍需要人工去识别与纠正。

最近,关于AI在学术界的两则完全对立的新闻,引起了学校对AI使用的讨论。

自2025年起,Nature出版社母公司Springer Nature开始大规模引入人工智能技术,对论文进行系统性审查,以提升学术出版的质量与可信度。该举措主要针对近年来日益严重的学术不端问题,尤其是“论文工厂”等批量制造论文的现象。通过部署AI工具,出版社能够在论文提交和审核过程中,对图像、文本和引用等关键内容进行自动检测。

在实际应用中,这些AI系统被用于识别多种潜在问题,包括实验图片的重复使用或篡改、参考文献的异常模式以及文本内容的生成或拼接痕迹。通过算法筛查,系统已对大量论文进行分析,并从中识别出约2.5万篇存在不同程度问题的论文线索。这些问题涵盖图像造假、引用不规范以及文本不真实等多个方面。编辑团队会对相关论文进行进一步核查,并根据具体情况采取相应措施,要求作者解释、修订稿件,或在必要时拒稿及撤稿。

AI在这一流程中主要承担“初步筛查”和“风险预警”的角色,大幅提升了审查效率,也减轻了人工审核压力。充分体现了学术界对学术诚信问题的零容忍态度,哪怕是已经发布的论文,也要面临撤稿。

目前,AI已经能帮审稿人准确定位有问题的论文部分,基本被认为是“铁证”。

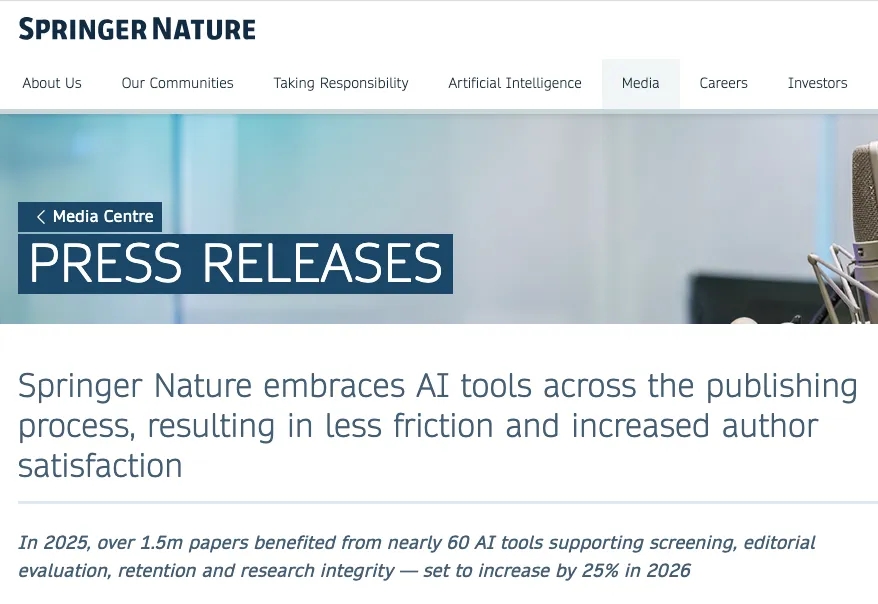

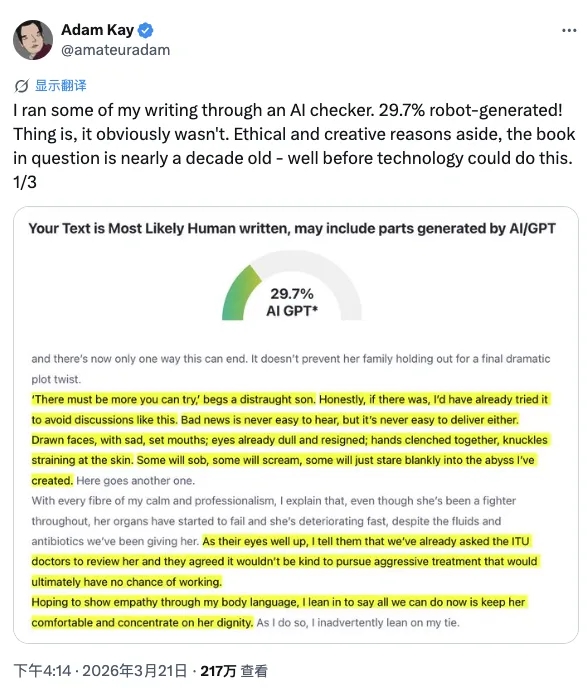

知名作家Adam Kay近日在社交媒体上分享了一次引发广泛讨论的实验:他将自己十年前出版的一本作品输入当前流行的AI内容检测工具,结果显示该文本有29.7%被判定为“由机器生成”。这一结果颇具讽刺意味,因为在十年前,生成式AI尚未发展到能够理解复杂句式的水平,更不可能参与该书的创作。

该帖子发布后迅速走红,浏览量突破210万,并引发网友广泛参与的“AI测谎仪挑战”。大量用户开始将自己的旧文章、论文、小说甚至手写内容输入各类AI检测工具,测试其“真实性识别能力”。结果显示,不少完全由人类创作的内容也被误判为“AI生成”,比例从十几到数十不等。

这一现象引发了对AI检测工具可靠性的质疑。许多专家指出,目前主流的AI检测器主要基于文本模式、句式规律和概率分布进行判断,本质上是一种“统计推测”,而非真正识别文本来源。因此,当人类写作风格较为规范、流畅或接近机器生成特征时,就容易被误判。

虽然,这两则新闻里的AI模型并不是同一个,但所表达出来的意思是,AI并不是“完美法官”。目前,大部分的美国大学都引入了AI检测系统来初步筛查学生作业是否存在学术违规的迹象,如果被识别出来,则会被上报学校学术诚信委员会(Honor Code)进行处理。

按照学校流程,学校会给予学生听证会机会。如果学生认为AI是误判的,可以在听证会上与学校说明,免除处分。但值得注意的是,有很大部分的留学生,是没有听证会经验的,并不清楚流程,也不清楚自己在该事件中,可以要求的合法权益。同时,也因为语言和文化环境陌生,而选择逃避,默认处分。殊不知,这将会对自己产生极大的毕业威胁与学术危机。

我们真诚的提醒广大留学生,在学术作弊的指控之中,除了“有没有违反”,更重要的,还要讨论“违反了多少,指控是否正确,AI计算的重复率是否误判”,这将直接影响到处分严重程度。需知道,一旦学校给出的是“停学”甚至更严重的处分,学生将同时失去学籍与F1签证的合法留美身份,将来,需要付出更大的代价去挽救。

AI与大学学习已经密不可分,只要用好,就是事半功倍的好工具,同时,被AI”捉“作弊,在学术案件中,要勇敢挑战AI,质疑AI。一定要积极应对,争取听证会机会,降低处分。

【有任何疑问,欢迎联系我,微信二维码如下图--济南启德美国部李永超】